IT之家 2 月 23 日消息,上海人工智能实验室在昨日举行的 2025 全球开发者先锋大会(GDC)“浦江 AI 生态论坛”上发布了通用具身智能仿真平台桃源 2.0(GRUtopia2.0),并面向全球开发者开放。

桃源 2.0 基于 2024 年 7 月发布的“城市级”仿真平台桃源 1.0 升级而来,通过模块化架构、自动化场景生成与高效数据采集三大核心技术升级。

IT之家注意到,上海 AI 实验室完成还宣布近期完成首次“虚实贯通”技术体系全闭环验证,在“真实-模拟-真实”(Real-to-Sim-to-Real)路径下,加速打造可自主演进的具身智能进程。

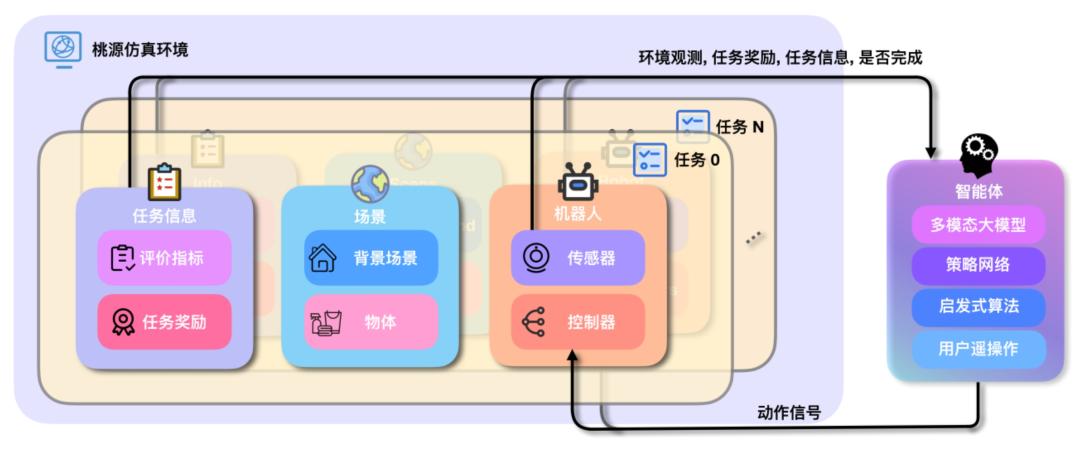

作为该体系核心,桃源 2.0 通过高性能仿真加速具身智能在虚拟环境中的训练效率,并实现向现实场景的平滑迁移。平台数据集、模型及工具链将陆续开源。

为实现单一平台覆盖从底层控制到顶层决策任务的“通用性”训练需求,上海 AI 实验室研究团队为 GRUtopia2.0 设计了功能全面的模块化框架,具备代码轻量和灵活拓展的特性,从而提升用户使用体验。模块化框架将训练任务拆解为“场景、机器人、任务指标”三要素,用户仅需三行代码即可完成任意具身任务的定义。平台内置多种机器人、控制器、评价指标、任务奖励等模块的实现,仅通过对原生模块的组合即可实现多种导航、操作和控制任务。

为满足用户对于定制化数据采集的需求,GRUtopia2.0 提供了面向操作、导航任务等高效数据收集管线。

弥补传统遥操作工具活动范围、距离感知、动作精度弱等带来的数据采集方式限制,研究人员为 GRUtopia2.0 引入 VR、动作捕捉、双手协调的等机器人遥操作手段,提升模拟数据采集效率。进一步拉低使用门槛,首创设计双手协调的“隔空操作模式”,无需视觉及操作硬件,通过动作捕捉即可控制机器人的运动、视角转换、坐标系重定位和运动精度调整的功能。相较传统空间鼠标方式,可实现 5 倍的操作效率提升,单人一天即可采集上百条复杂操作数据。

在面向导航的数据采集管线中,GRUtopia2.0 利用全局地图 ESDF 并行采样合成海量轨迹数据,较人工操作传统方式提升近 20 倍。同时设置了针对轮式、足式及虚拟机器人提供了默认的路径规划控制器,以实现在 GRScenes-100、Matterport3D 场景中自动化的路径跟随和观测、动作数据采集。平台还提供了批量化工具,支持进行并行的大规模导航数据采集。

还没有评论,来说两句吧...